sábado, 19 de diciembre de 2020

Seleccionar y entrenar un modelo de Machine Learning

sábado, 12 de diciembre de 2020

AWS in a nutshell 7: Administración de Costes

Exploraremos las herramientas de administración de costos para ayudar a minimizar los costos de AWS, así como la administración central de escritorios y servicios de aplicaciones.

7.1 Explorador de costos y la GUI

7.2 Explorador de costos en CLI y Powershell

Podemos utilizar AWS CLI para acceder al explorador de costos de los servicios web de Amazon. Como su nombre indica, permite determinar de dónde proviene la mayor parte de nuestros cargos. Desglosa los cargos mensuales de computación en la nube.

Se hace por comandos

También podemos usar Microsoft PowerShell para recuperar datos del explorador de costos de AWS.

7.3 Presupuestos de costos

Podemos configurar los presupuestos de costos de AWS con un valor de umbral especificado, por ejemplo 400 €, de este modo nos asegurarnos de realizar un seguimiento de los cargos mensuales, también hay alarmas que se activan cuando excedemos el valor de umbral configurado.

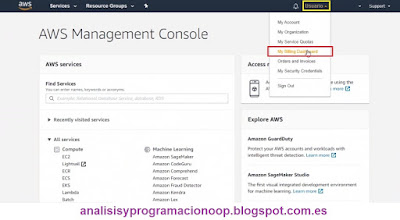

Accedemos desde la consola de AWS → [Usuario] → My Billing Dashboard → budgets y pulsamos botón crerate a budget → Cost Budget

7.4 Presupuestos de uso

La mayoría de la gente asocia la tarea de crear presupuestos con valores monetarios. Y aunque eso es importante, y podemos crear esos presupuestos de costos en AWS, también podemos crear presupuestos basados en el uso de recursos en la nube. En nuestro caso, se tratará de cuántas horas se ejecutan las instancias EC2 en un período de un mes.

Consola → [Usuario] → My Billing Dashboard → budgets y pulsamos botón crerate a budget → Usage Budget

7.5 Pagos del solicitante del depósito de S3

En ocasiones, es posible que tengamos contenido almacenado en un depósito S3 que es requerido por un tercero o por una organización empresarial asociada, y es posible que deseemos cobrarles por esa transferencia de datos, ya que la necesitan y están incurriendo en cargos como resultado de ese uso.

Consola → S3 elegimos nuestro bucket S3 y pulsamos pestaña propierties → Requester Pays → Enabled Requester Pays

7.6 Instancias puntuales

Las instancias puntuales son una excelente manera de ahorrar dinero cuando necesitamos activar potencia de cómputo, para ejecutar una tarea o algunas pruebas rápidas, pero luego ya no lo necesitamos. Lo único es que la capacidad informática no está garantizada y es por eso que no utilizaremos instancias puntuales para ninguna carga de trabajo de misión crítica.

Consola → Spot Requests pulsamos borón requests Spot instances y Flexible Workloads

7.7 Instancias reservadas

Al igual que las instancias puntuales, en AWS, el uso de instancias reservadas puede permitirnos ahorrar mucho dinero en lo que respecta a la potencia informática de EC2 subyacente. Sin embargo, la diferencia es que con las instancias reservadas, tenemos un compromiso inicial de uno o hasta tres años. Nos permite obtener capacidad informática disponible con un gran descuento, pero con las instancias puntuales realmente no hay ningún compromiso.

Consola → EC2 → Reserved Instances → Purchased Reserved Instances

7.8 Amazon WorkSpaces

Amazon Workspaces es una solución VDI, Virtual Desktop Infrastructure, mediante la cual los podemos usar muchos tipos diferentes de dispositivos cliente para establecer una conexión con nuestro escritorio, que está alojado en Amazon Web Services, ya sea que ese escritorio ejecute Linux o Windows con aplicaciones.

Nuestra infraestructura de escritorio virtual, dentro de la organización. Amazon Workspace ofrece escritorios virtuales Windows o Linux a los usuarios. Los usuarios nos conectamos a escritorios virtuales de Windows o Linux alojados en la nube de Amazon Web Services. Para configurarlo, una de las primeras cosas que debemos hacer es especificar el tipo de servicio de directorio, que queremos, por ejemplo, un servicio de directorio activo completo en la nube o un servicio de directorio activo simple, y la Asociación de VPC.

Consola → workspaces → Botón launch workspaces

7.9 Gestión de Amazon WorkSpaces

Una vez hemos creado un Amazon WorkSpace o un escritorio virtual basado en la nube para un usuario, podemos realizar cambios en él.

Consola → workspaces → Botón Actions → Edit users

7-10 Imágenes de Amazon WorkSpaces

Podemos crear imágenes personalizadas del espacio de trabajo de Amazon.

pulsando create Image en el menú de arriba

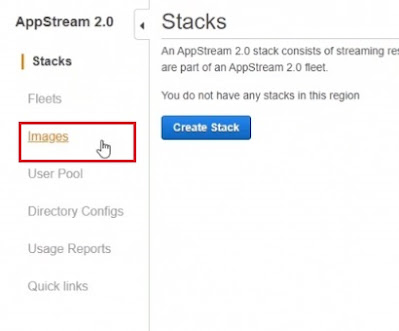

7-11 AppStream

Amazon AppStream es una solución de aplicación mediante la cual es esencialmente una herramienta administrada. Las aplicaciones se ejecutan en Amazon Web Services en instancias, pero eso está oculto para nosotros. Todo lo que necesitamos saber, es que podemos establecer una conexión desde nuestro navegador web para transmitir o ejecutar la aplicación. Podemos estar usando un PC, un Mac, o un Chromebook, un dispositivo Android, o un dispositivo iOS; no importa. Tenemos una manera fácil de ejecutar nuestras aplicaciones, al menos las aplicaciones que tengamos a nuestra disposición. Los datos que resultan del uso de la aplicación también se pueden almacenar en AWS dependiendo de cómo lo hayamos configurado en el administrador.

Consola → AppStream → images

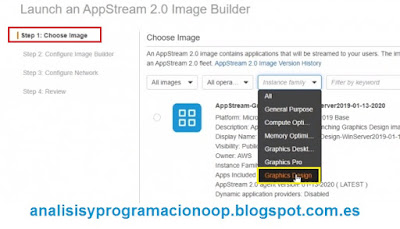

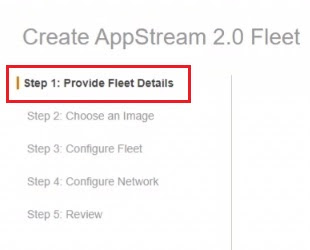

7-12 Flotas y pilas de AppStream

Cuando tenemos una imagen de aplicación personalizada en la que hemos colocado aplicaciones y las publicamos con el asistente de imagen, la siguiente tarea es asignarle a una flota.

7-13 AppStream en acción

Amazon AppStream permite a los usuarios ejecutar aplicaciones que están realmente alojadas en la nube de AWS a través de un navegador web habilitado para HTML 5 o, si es necesario, podemos instalar el cliente AppStream, que es necesario si deseamos utilizar cosas como más de dos monitores para ejecutar nuestra tu aplicación.

Consola → AppStream → User Pool