En esta entrada veremos los bloques de construcción y componentes esenciales que se utilizan o participan en la construcción de redes neuronales artificiales. Veremos la arquitectura de estas, y los componentes que se utilizan para construir el modelo correcto para dar soluciones predictivas a diversas aplicaciones comerciales. Los componentes principales incluyen las capas de entrada de salida y ocultas.

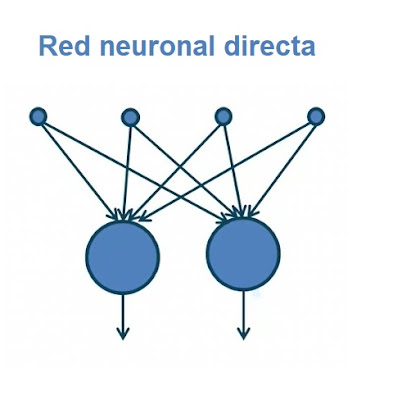

Las capas están formadas por distintas neuronas con enlaces de conexión que conectan las neuronas para facilitar el flujo de información. Existen varios tipos de redes neuronales que podemos construir alineando los elementos arquitectónicos según nuestros requisitos. Por ejemplo, podemos construir una red neuronal directa, una red neuronal de retroalimentación, o una red recurrente, donde las salidas alimentan de nuevo las entradas. En la figura inferior se muestra un esquema de la arquitectura de una red neuronal de alimentación directa, donde la información fluye solo en una dirección.

Podemos observar un flujo de información unidireccional. Comienza desde la capa de entrada y termina en la capa de salida. No existe el concepto de retroalimentación o bucles en las redes neuronales directas. Y a menudo se las conoce como redes neuronales sencillas que identifican directamente la relación entre las entradas y las salidas. La implementación de redes neuronales de alimentación directa se puede encontrar en aplicaciones que involucran generación de patrones, reconocimiento de patrones y clasificación.

En una red de retroalimentación el flujo de información es bidireccional, este tipo de red involucra bucles de retroalimentación. En este caso, el estado de la red tiende a cambiar con frecuencia, también se conoce comúnmente como red neuronal dinámica. Podemos observar claramente el flujo de información bidireccional causado por los bucles de retroalimentación de la figura.

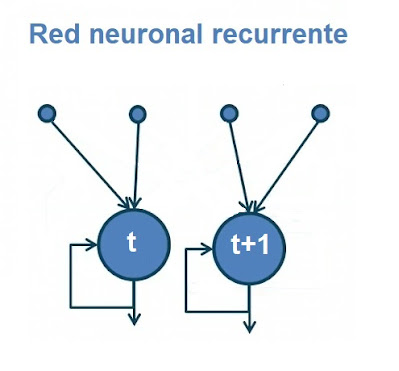

La tercera figura ilustra la arquitectura de una red neuronal recurrente. Esta red en particular utiliza memoria para almacenar toda la información de los pasos anteriores para facilitar el siguiente paso de aprendizaje.

La figura ilustra el uso de la información de los pasos anteriores o del estado anterior para generar el estado actual. Con las redes neuronales tradicionales, las entradas y las salidas tienden a ser independientes entre sí. Pero surgen ciertos escenarios en los que necesitaríamos la red neuronal para almacenar y utilizar resultados anteriores. Tales escenarios requieren la implementación de una arquitectura de red neuronal recurrente.

La estructura de una red neuronal artificial está inspirada en el cerebro humano, el cual está formado por una gran cantidad de elementos de procesamiento altamente conectados llamados neuronas. Podemos configurar redes neuronales artificiales con tareas específicas mediante un proceso de aprendizaje que imita al sistema biológico.

Las neuronas de las redes neuronales artificiales suelen estar organizadas en tres capas diferentes, la capa de entrada, la capa oculta y la capa de salida.

Como buena práctica, se sugiere que combinemos redes neuronales usando reglas de lógica estructurada.

Para entrenar una red neuronal necesitamos entrenarla con unos datos, y ajustar algunos parámetros para inicializar la red y evitar el sobreajuste o sesgo de esta. Después de inicializar la red neuronal, tenemos que iniciar el proceso de aprendizaje que generalmente es de naturaleza iterativa y repite ciertos pasos para cada parámetro de entrada. A continuación creamos una muestra o lote que es un subconjunto de los datos de entrenamiento, Con cada salida de la red comparamos los datos obtenidos con la muestra y se reajusta la red con el objetivo de que el próximo paso la salida esté más cercana a la que debería tener.

Repetiremos estos pasos hasta que la salida de la red converja y se ajuste a nuestro modelo. Finalmente, cuando termina la iteración, el resultado que obtenemos es una red entrenada.

Ahora, veremos algunos de los parámetros esenciales que juegan un papel crítico e importante en la construcción de redes neuronales. El primer tipo de parámetros es la arquitectura del modelo. Debemos controlar el número de capas, el número de neuronas por capa y el tipo de capa, ya sea de entrada, salida u oculta.

El segundo tipo de parámetro es el parámetro a tener en cuenta es la función de aprendizaje. Este parámetro en particular ayuda a orientar el enfoque y la tasa de aprendizaje que podemos establecer para optimizar el proceso de aprendizaje. Uno de los parámetros de aprendizaje más importantes en uso es la tasa de aprendizaje. Si establecemos una tasa de aprendizaje pequeña, el proceso de aprendizaje puede llevar mucho tiempo. Y si establecemos una gran tasa de aprendizaje, puede afectar negativamente el rendimiento del aprendizaje.

Otro tipo de parámetro es el parámetro de optimización. Este parámetro se utiliza para optimizar el modelo de red neuronal. Algunos de los parámetros de optimización esenciales que debemos configurar incluyen el tamaño del lote, el impulso y los pesos. El último parámetro es el parámetro de ajuste. Los parámetros de ajuste se utilizan para ajustar las redes con el fin de proporcionar mejores resultados de aprendizaje después de haber aplicado los datos de entrada.

Algunos de los parámetros de ajuste esenciales incluyen el número de épocas y el tamaño del lote

No hay comentarios:

Publicar un comentario